チップは忘れろ、AIに重要なのはシステムだ

オリジナル記事「Forget About Chips. It’s the System That Matters For AI」

特定のワークロードに適したプロセッサを選ぶことは、常に重要だ。しかし、AI、より具体的にはAI推論に関しては、個々のチップの選択よりも、システム全体のアーキテクチャの方が重要である。本日、d-MatrixによるGigaIOのデータセンター事業買収、および今週初めにエヌビディアがMarvellに対して行った20億ドルの投資は、この事実を裏付けている。

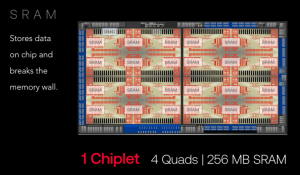

d-Matrixは当初、PCIバスに直接接続するチプレットとして提供する独自のデジタル・インメモリ・コンピューティング(DMIC)技術を開発したことで名を馳せた。同社の最新インメモリ・コンピューティング製品「Corsair」は、3次元デジタル・インメモリ・コンピューティング(3DMIC)を採用しており、プロセッサをPCIe Gen5に接続されたSRAMモジュールに直接統合している。Corsairは、大規模言語モデルを活用したAI推論のために特別に開発されたもので、150 TB/sのメモリ帯域幅を提供する。これにより、AIモデルがデータと接続し、より良い結果を迅速に導き出すことが可能になる。

カリフォルニア州サンタクララに拠点を置く同社は、昨年11月のシリーズCラウンドで2億7500万ドルを調達し、2022年の創業以来の総調達額は4億5000万ドルに達しているが、本日、初の買収を発表した。d-Matrix は、カリフォルニア州カールスバッドに拠点を置くGigaIOのデータセンター事業を買収する。GigaIOは、PCIおよびCXL規格を用いてGPU、FPGA、その他のXPUを接続する「FabreX」と呼ばれるコンポーザブル・インフラストラクチャを開発している。GigaIOは、最大32個のXPUを単一のノードに接続する「SuperNODE」プラットフォームでFabreXを採用している。

|

|

| d-MatrixのCorsairプロセッサは、3D積層型チプレット・フォームファクタにインメモリ演算機能を組み込んでいる | |

今回の買収は、AI推論には単なる高速チップ以上のものが必要であることをd-Matrixが理解していることを示している。「推論は、単一のチップの枠を超えた問題だ」と、d-Matrixの創業者兼CEOであるシド・シェス氏は述べた。「今やそれはシステム全体の問題なのだ。」

将来、AIで成功を収めるには、ワークロードを小さなタスクに分割し、CPU、GPU、推論アクセラレータなど、多種多様なプロセッサタイプで実行する必要があるとシェス氏は述べた。

「つまり、データはチップ、ノード、ラック、そしてデータセンター全体をリアルタイムで効率的に移動しなければならない」と彼は語った。「今回の買収により、低遅延、効率性、スケーラビリティがすべて同時に重要となるこの新たな現実に対応したインフラを提供する当社の能力が加速する。」

GigaIOは、エッジコンピューティングに注力する独立した企業として事業を継続する予定だ。同社は最近、Gryfを発表した。これはジェット機の頭上収納棚に収まる「ポータブル・スーパーコンピュータ」として位置付けられている。

エヌビディアもまた、チップの枠を超えて事業を展開している。「ビッグ・グリーン」は、その強力なGPUのおかげで世界一の時価総額を誇る企業となった。2022年末にOpenAIがChatGPTをリリースして現在のAIブームを巻き起こして以来、同社のGPUは高い需要を維持している。同社のロードマップでは、さらに強力なGPUの開発が予定されており、現在のBlackwellに続き、2026年にはRubin、2028年にはFeynman GPUが登場する予定だ。

|

|

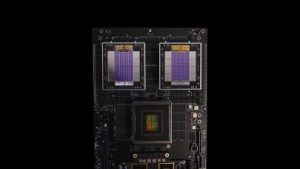

| NVLink Fusionは、他社製のAIアクセラレータをエヌビディアのVera Rubinプラットフォームに接続する | |

しかし、エヌビディアでさえ、GPU一つだけでは優れたAIは実現できないことを認識している。先ごろ開催されたGPUテクノロジーカンファレンスでは、同社の新しいVera CPUや、昨年12月に200億ドルを投じて買収したグロッグ言語処理ユニット(LPU)など、他の種類のチップに関するニュースが数多く発表された。ジェンセン・フアン氏は、AIを成功させるには同社の7種類のチップすべてが必要だと断言しており、これらを現在は「Vera Rubinプラットフォーム」と呼んでいる。

「多くの人は、エヌビディアの事業が単なるチップ企業よりもはるかに多角化していることを忘れている」とファン氏は3月のGPCでの記者との質疑応答の中で述べた。「その理由は、我々がフルスタックであり、どこにでもAIファクトリーを構築できるよう支援できるからだ。」

エヌビディアは今週、サンタクララに拠点を置く時価総額80億ドルのカスタムチップメーカーであるMarvellに20億ドルを投資すると発表し、この動きをさらに強化した。Marvellは、AIアクセラレータ、スイッチ、ストレージコントローラ、ゲーム機、シリコンフォトニックデバイス向けのASICなど、多様なカスタムシリコンを開発している。同社はAWSと提携し、AIモデルトレーニング用のTrainium XPUを開発した。また、Microsoft Azure、Google Cloud、Oracle Cloud Infrastructureとも提携している。

|

|

エヌビディアによる20億ドルの投資は、MarvellとNVLink Fusionとの連携強化を目的としている。NVLink Fusionとは、エヌビディアが独自のスケールアップ型NVLinkインターコネクトを中核としたオープンなエコシステムを構築する計画である。エヌビディアによると、MarvellはカスタムXPUおよびNVLink Fusion対応のスケールアップ型ネットワークコンポーネントを提供する。一方、エヌビディアは、Vera CPU、ConnectX NIC、BlueField DPU、NVLinkインターコネクト、Spectrum-Xスイッチに加え、「AIコンピューティング」(すなわちGPU)を含む、スタックの残りの部分を提供する。

「エヌビディアとのパートナーシップ拡大は、AIのスケーリングにおいて、高速接続、光インターコネクト、およびアクセラレーテッド・インフラストラクチャの重要性が高まっていることを反映している」と、Marvellの会長兼CEOであるマット・マーフィー氏は述べた。「Marvellが持つ高性能アナログ、光DSP、シリコンフォトニクス、カスタムシリコンにおけるリーダーシップを、NVLink Fusionを通じてエヌビディアの拡大するAIエコシステムと結びつけることで、顧客がスケーラブルで効率的なAIインフラを構築できるようにする。」

12月、Marvellは、スケールアップ型光インターコネクトを開発していたCelestial AIを32億5000万ドルで買収した。Celestial AIは、最大16テラビット/秒の帯域幅を実現できるスケールアップ型光インターコネクト「Photonic Fabric」を開発していた。Marvellは、Celestial AIのインターコネクトを自社のUALinkサポートに組み込むものと見られていた。しかし、現在はエヌビディアおよび同社のNVLink Fusionインターコネクトアーキテクチャと連携していることから、このUALinkが今後どのように進化していくのか注目される。

メモリの壁を打ち破る手段としてUALink、NVLink Fusion、あるいはUltra Ethernetのいずれが採用されるにせよ、近年のAI推論における限界を押し広げるには、個々のチップの能力を超えたシステム全体のアプローチが必要であることは明らかだ。