ARM、AI推論向けの新データセンター用CPUを発表

オリジナル記事「Arm Flexes with New Data Center CPU for AI Inference」

アーム・ホールディングスは今週、AI推論やエージェンティックAIワークロードという急成長市場向けに設計された新チップ「AGI CPU」を発表した。AGI CPUは、アームにとって35年の歴史において初めて顧客に直接提供するシリコン製品(IPや完全なサブシステムの販売とは対照的)であり、同社にとって初の試みとなる。AGI CPU搭載サーバ向けのリファレンスデザインも発表したこの英国企業は、AIブームのシェアを獲得する同チップの潜在力に明らかに強気であり、CEOは2031年までにこの新チップが150億ドルの収益をもたらすと予測している。

この新しいAGI CPUは、いくつかの驚異的な性能を誇る。ArmがMetaと共同設計したこのチップは、TSMCの3nm N3Pプロセスを用いたチップレット設計に基づいている。136個のNeoverse V3コアはそれぞれ3.5GHz(デュアルチップ構成では3.7GHz)で動作し、コアあたり2MBのL2キャッシュを搭載している。

各コアは6GBpsのメモリ帯域幅を提供し、チップ全体ではチップあたり12レーンを介して6TBのDDR5 RAMにアクセス可能で、100ナノ秒以下のレイテンシで合計800GBpsのメモリ帯域幅を実現する。

|

|

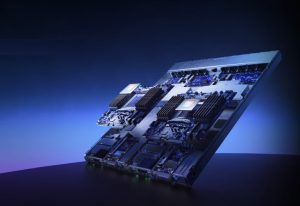

| ラックスケール・リファレンス・アーキテクチャ向けArm AGI CPUブレード | |

この新しいAGIチップは、96レーンのPCIe Gen6接続を備え、メモリ拡張のためのCLX 3.0に対応している。Armはこれらすべてを300ワットのTDP内に収めた。Armは、この新しいAGIチップのメモリ帯域幅とスレッドあたりの性能を強調しており、これにより顧客はエネルギー予算の範囲内で、新たなエージェンティックAIのワークロード要件を満たすことができるとしている。

現在、CPU市場は活況を呈している。AIブームにより、AI推論やエージェンティックAIに必要な幅広いタスクを処理できる汎用チップへの需要が高まっているためだ。高性能GPUはAIモデルのトレーニングやAI推論の第一段階(プリフィルと呼ばれる)には適しているが、AI CPUの第二段階(デコードと呼ばれる)には理想的ではない。この段階では、サンドボックス環境の立ち上げ、生成されたコードの実行、KVキャッシュからのデータ取得、SQLクエリの処理、そして機械学習のフィードバックサイクルの一環としてこれらすべての機能を改善できるよう監視するなど、多数のタスクを完了する必要があるからだ。

先週開催されたGPUテクノロジーカンファレンスで、エヌビディアは新製品「Vera」を大々的にアピールした。これは88コアのARMチップであり、標準的なX86チップの1.5倍の性能と3倍のメモリ帯域幅(チップあたり1.2 TBpsで、Armの新しいAGI CPUを上回る)を実現すると同社は主張している。エヌビディアはまた、顧客のAIファクトリー構築の一環として、タスクを処理するためのVera CPUをラック単位で販売している。これらはすべて、エヌビディアの「推論の王者」というビジネスモデルの一環だ。

ArmがAGI CPUを発表したことは、同社が「推論の王様」の経済圏にも本格的に参入しようとしていることを示している。従来、エヌビディア、Meta、Google、Microsoftといった企業と提携し、ARM設計に基づくカスタムチップの開発を行ってきた同社は、今や独自にチップ事業に踏み出している。

また今週、Armは超高密度ラック展開向けの新しいリファレンスサーバ構成を発表した。最初のリファレンスデザインはOpen Compute ProjectのDC-MHS設計に基づいており、ブレードあたり最大272コアをサポートする2チップ構成のAGI CPUを採用している。36kWの空冷ラックあたり最大30ブレードを搭載可能で、このリファレンスサーバは合計8,160コアを実現する。また同社によれば、ArmはSupermicroと共同で、336個のAGI CPUを搭載可能で45,000コア以上を実現する水冷式200kWラックの開発も進めている。1ギガワット規模のAI工場において、これはX86と比較して100億ドルの設備投資削減につながる、とArmは主張している。

「グローバル規模でAI体験を提供するには、AIワークロードを高速化し、Metaのプラットフォーム全体でパフォーマンスを最適化するために専用設計された、堅牢かつ適応性の高いカスタムシリコンソリューションのポートフォリオが必要だ」と、Metaのインフラ責任者であるサントシュ・ジャナールダン氏は述べた。「我々はArmと協力してArm AGI CPUを開発し、データセンターのパフォーマンス密度を大幅に向上させ、進化するAIシステムのための複数世代にわたるロードマップをサポートする、効率的なコンピューティングプラットフォームを展開することを目指して取り組んだ。」

|

|

Armは、Cloudflare、F5、OpenAI、Positron、Rebellions、SAP、SKテレコムなど、さまざまなパートナーと協力してAGI向けCPUの展開を進めている。半導体メーカーのセレブラス社は、自社の「Wafer Scale Engine」をAI推論向けの最有力チップと位置付けているが、AI導入を成功させるために必要なその他の多様なタスクを処理するための、より小型のCPUの必要性も認識している。

「これらのシステムには、データ移動、ネットワーク、大規模な調整を効率的かつスケーラブルに統括するCPUに加え、専用に設計されたAIアクセラレーションが必要だ」と、セレブラス社のCEOであるアンドルー・フェルドマン氏は述べた。「ArmのコンピューティングプラットフォームをAGIクラスのインフラへと拡張することは、エコシステムにとっても、また世界規模でAIを展開する顧客にとっても前向きな一歩だ。」

2026年3月24日にサンフランシスコで開催された発表イベントで、ArmのCEOレネ・ハース氏は、この新しいAGI CPUチップの販売だけで、2031年までに英国ケンブリッジに拠点を置く同社に150億ドルの収益をもたらすと述べた。ハース氏は、2024年の総売上高が約40億ドルだった同社が、2031年までに250億ドルに達すると予測する。

ハース氏は、今後台頭するAI推論ワークロードにより、近い将来、CPUの需要が4倍になると予測した。「その数字は控えめな見積もりかもしれない」と、CNBCの記事によるとハース氏は述べた。「需要は我々が考えているよりも高いと思う。」

新チップの発表翌日、Armの株価(NASDAQ: ARM)は16%上昇した。同社の現在の時価総額は1,668億ドルである。

ArmのAGI CPUは、顧客のエージェンティックAIワークロードを確実に支援するだろうが、それだけで汎用人工知能(AGI)の実現につながることはないだろう。なぜなら、AGIの実現にはまだ数十年かかると、ほとんどのAI専門家が考えているからだ。