AIブーム、データセンターの電力供給と冷却に大きな変化をもたらす

オリジナル記事「Big Changes In Store for Data Center Power and Cooling, Thanks to AI Boom」

7年前、マーク・ガーナーがシュナイダーエレクトリックのデータセンター事業に加わった頃、数メガワットの受注は大きな成果だった。「当時は2~5メガワットの契約が決まると祝っていたものだ」と、シュナイダーのクラウド&サービスプロバイダー部門グローバルプレジデントであるガーナーは語る。「そして今や、ギガワット単位の話になっている。実に興味深い展開だ。」

明らかに、AIブームはシュナイダーのような企業にとって追い風となっている。シュナイダーはフランスに拠点を置く、190年の歴史を持つエネルギーソリューションの巨人だ。同社のクラウドおよびデータセンター事業からの収益は現在、シュナイダーの総収益の約4分の1を占めており、昨年の総収益は381億5000万ユーロ(現在の為替レートで約440億ドル)だった。しかし、シュナイダーのCEOであるオリヴィエ・ブルムの予測通り、今後15年間でコンピュータが電力消費量を60%増加させるとすれば、その割合は大幅に上昇することになる。

「現時点では驚異的な状況だ。具体的な数字は挙げられないが、需要の増加は著しい」とガーナーは、先ごろ開催されたGTC 2026カンファレンスで『HPCwire』に語った。「この業界に入って7年になるが、これほどの市場は見たことがない。非常にダイナミックだ。」

|

|

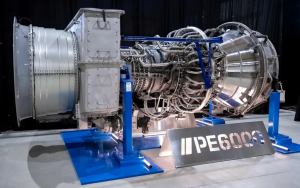

| GEエアロスペースのCF6-80C2ターボファンエンジンをベースにしたProEnergy社のPE6000ガスタービンエンジンは、48メガワットの電力を発電できる。(画像提供:ProEnergy) | |

AIブームにより、企業はデータセンターの建設、電力供給、冷却の方法について根本的に見直している。産業用電気システムの構築において2世紀近くの実績を持つシュナイダーは、同時に進行している複数の変革を支援する上で、最適な立場にある。

データセンターの建設地選びは、最初に検討すべき事項の一つだ。データのセンター向け液体冷却ソリューションを提供するIR Prosによると、米国の地方部では電力網に余剰電力が多く見られる傾向があり、これがテキサス州で現在6.5ギガワット規模のデータセンターが建設中である理由の一つとなっている。

電力供給が課題となっている国内の他の地域では、「BYOP(Bring Your Own Power)」が主流となっている。マイクロソフトは、ペンシルベニア州ミドルタウンにあるスリーマイルアイランドの1号原子炉を再稼働させ、データセンターの電源とする計画だ。IEEE Spectrumが最近報じたように、他のデータセンター事業者も、商用ジェット機の動力源となる大型ターボファンエンジンを改造し、必要な電力を確保しようとしている。

もう一つの大きな変化は、すでに本格化している液体冷却への移行だ。GPUやその他のAIアクセラレータの採用によりスーパーコンピュータの演算密度が極めて高くなったため、液体冷却は長年にわたりHPC(ハイパフォーマンスコンピューティング)施設で利用されてきた。しかし現在、世界中で数十ギガワット規模のAIファクトリーが建設中であることから、液体冷却は主流になりつつある。

|

|

| Vera Rubin NVL72のTDPは最大227 kWに達する | |

この変化を背景に、シュナイダー社は2024年12月、HPCシステム向け液体冷却のリーダー企業であるMotivairの支配権を8億5000万ドルで取得した。

一般的なコンピュータラックは1ラックあたり2~5 kWの電力を消費するが、高密度ラックの中には10~30 kWを消費するものもある。しかしAIの普及により、1ラックあたり100kWの電力を消費するケースも珍しくなくなっている。例えばNvidiaのGrace Blackwell NVL72は熱設計電力(TDP)が120kWから132kWだが、新製品のVera Rubin NVL72システムではこれが227kWにまで引き上げられている。将来のNvidiaシステムは最大400kWに達し、1つのラックで1メガワットの電力を消費するという話さえ出ている。これは最大1,000世帯分の電力を賄えるほどのエネルギーだ。これだけの電力によって発生する熱に対処するには、液体冷却が不可欠である。

「私がデータセンター業界に入った当初、ある人から『データセンターは巨大なヘアドライヤーのようなものだ』と言われた」とガーナーは語った。「電力を投入すれば、熱風が出てくる。これはそこで起きていることを表す、実に適切な例えだ。しかし現在我々が直面しているのは、ラック内で処理される計算密度が高まっているため、熱を全く異なる方法で排出する必要があるということだ。そこで液体冷却が必要となる。シュナイダーが数年前にMotivairを買収した理由はそこにある。」

この極めて高い演算密度により、HPCシステムの電源供給方法にもう一つの大きな変化がもたらされている。それは、800ボルトの直流(DC)電源の採用だ。

すべてのコンピュータは直流(DC)電源で動作するが、電力網からの電力は交流(AC)である。通常、各コンピュータやデバイスは、外部電源ボックスを介して、交流(AC)電源から直流(DC)への変換を独自に行っている。

Nvidiaは、データセンターの大部分を800V直流電源に移行することを構想している。これにより、デバイスごとに電源を変換する必要がなくなる。GPUに800V直流を直接供給すれば、配線面での利点も得られる。高電圧回路ではより細い銅線を使用できるからだ。また、交流と直流の変換を行うたびに発生する電力損失も解消される。

800V DCの実現にはまだ至っていない。Nvidiaは、現在のVera Rubinシステムから移行を開始し、それに続くFeynman世代で完全なネイティブ800V DCへ移行する意向だ。しかし、シュナイダーやVertivといったNvidiaのパートナー各社は、800V DCの未来に向けて準備を進めている。

|

|

| Switchはシュナイダーと提携し、同社のデータセンターモデリングソフトウェアをNvidia Omniverseに組み込む(画像提供:Switch) | |

「我々の仕事の多くは、常に2世代先を見据えることに尽きる」と、世界最大級のデータセンターに電力・冷却ソリューションを提供するVertivの米州担当プレジデント、アナンド・サンギは語る。「データセンターの設計や導入には時間がかかるため、我々は2年後に登場する予定のチップセットをすでに検討しているのだ。」

800V DCの導入方法には様々なバリエーションがある、とサンギは述べた。

「ある人は、一定レベルまではACを引き込み続け、そこからサイドカー方式で変換すると言うだろう」と、彼はGTC2026でHPCwireに語った。「また、変電所から入ってきたらすぐにDCに変換し、その後はずっとDCで運用すると言う人もいる。つまり、複数のアーキテクチャが存在する。理想的には、変換を一度行い、その後は終始DCを維持したいところだ。」

データセンターの構築において設計者にさらなる柔軟性をもたらす、もう一つの大きな変化がある。それは、ソリッドステート変圧器の登場だ。

1831年にマイケル・ファラデーが「誘導リング」を開発して以来、従来の変圧器技術は大きく変化してきた。彼は、鉄心に銅線を巻きつけることで、電気の電圧を変えることができることを発見した。しかし、シリコン化学から発展した、はるかに高度なソリッドステート変圧器が普及し始めている。鉄心変圧器よりは依然として高価だが、ソリッドステート変圧器には、複数のエネルギー変換に対応できる能力や、バックアップにおいて重要な双方向のエネルギーフローなど、いくつかの利点がある。

|

|

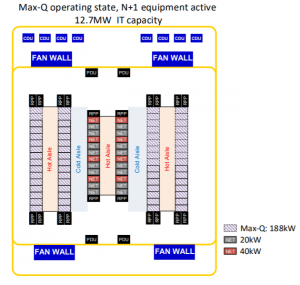

| シュナイダーのAIデータセンター向けリファレンスデザインは、トークン生成にMaxQとMaxPの2つのモードを備えている(画像提供:シュナイダーエレクトリック) | |

データセンターの運営者は、ソリッドステート変圧器が多様なタスクを処理し、通常は単一の機能しか持たない複数の従来型変圧器や、さらには無停電電源装置(UPS)さえも単一の筐体で置き換えることを期待している。これにより、データセンターの電気設計が簡素化され、GPUやネットワーク機器のためのスペースが確保されることになる。この可能性により、DG Matrix、Heron Power、Amperesandといったソリッドステート変圧器ベンダーは、今年、数億ドルの資金調達に成功した。

これほど多くの要素が絡み合うと、圧倒されてしまうこともある。これが、Nvidiaがパートナー企業に対し、データセンターの設計を支援するため、Omniverse DSX Blueprint内でデジタルツイン技術を採用するよう推奨している理由の一つだ。

「ここで重要なのは、システムレベルの思考だ」とVertivのサンギは言う。「あらゆるモデリングを行い、AIファクトリー全体を展開するためにアーキテクチャがシステムレベルであることを確保すれば、世界中のどこでも迅速かつ大規模に実現できるのだ。」

NVIDIAのデジタルツイン技術を活用しているシュナイダーエレクトリックは、Vera Rubin NVL72ラック向けの新しいAIリファレンスデザインを発表した。このリファレンスデザインは、ラックあたりの定格電圧を480V ACに引き上げること、冷水(45°C)による液体冷却、および最大トークン生成(MaxP)とMaxQへの対応など、NVIDIAの最新要件をサポートしている。

「ある会社からチラーを、別の会社からCDU(冷媒分配ユニット)を購入することも可能だし、実際に多くの企業がそうしている」と、シュナイダー社のガーナーは述べた。「しかし、そのシステムの統合やエンドツーエンドの自動化、つまり『システム・オブ・システムズ』とその仕組みは、効率性の観点から見て極めて重要になるのだ。」

「現在、この業界で行われている議論のほとんどは、スピードと規模に集中している。いかにしてインフラをより迅速に提供するか、ということだ」とガーナーは続けた。「我々が提供している規模は、かつてないほどのペースで拡大している。」

編集部注:本記事は、Vera Rubin NVL72システムのTDP増加を反映して更新された。