HPCはAIの恩恵に乗っている。では次にどうする?

オリジナル記事「HPC Is Riding AI’s Coattails. So Now What?」

HPCコミュニティは、自らを独立した存在と見なし、その崇高な目的には大規模な資金提供が相応しく、壮大な課題に取り組むための新たな計算ソリューションを生み出すに値すると考えるかもしれない。しかし現実には、HPCは消費者向けAIワークロードの構築と運用に専念する、はるかに巨大なコンピューティングコミュニティの一角に過ぎない。これに抗う意味は全くない。したがってHPCコミュニティにとっての核心的な問いは、次に何をすべきかということだ。

これは最近、3人のHPCリーダーが提示した結論と疑問である。ジャック・ドンガラ、デニス・ガノン、ダニエル・リードは「波に乗り、未来を築く:AI世界における科学計算」と題した論文で、AIブームが先進計算の重心をどう変え、科学計算が依存してきた計算環境と経済構造を再構築したかを説明した。

5,800語に及ぶこの論文(こちらで閲覧可能)は、先進的コンピューティングコミュニティに影響を与えた近年の変化を詳述している。これは3年前に3名が執筆した「HPC予測:混迷と不確実性」と題する類似論文の続編にあたる。以前の論文(こちらで閲覧可能)では、ドンガラ、ガノン、リードは、高度なコンピューティングの重心が既に移動し、半導体の制約が新たなアプローチを推進し、ハイパースケーラーとスマートフォンプロバイダがサプライチェーンと経済性を変容させていると主張した。さらに、HPCアプリケーションの性質が急速に変化しており、エンドツーエンドのハードウェア共同設計と大規模プロトタイピングが必要であると指摘した。

これらの傾向は2026年まで継続しただけでなく、新たな大規模な破壊的トレンドが出現した。特に生成AIの登場が世界的なAIブームを引き起こしたのだ。このAIブームこそが、何よりもHPCと科学計算の本質を塗り替えつつある。

|

|

| 左から:デニス・ガノン(インディアナ大学名誉教授)、ダニエル・リード(ユタ大学大統領特別教授)、ジャック・ドンガラ(テネシー大学名誉教授) | |

「今日、主要なコンピューティング市場は間違いなくAI主導だ」とドンガラ、ガノン、リードは『Ride the Wave』で記している。ハイパースケールシステムのエネルギーと冷却需要は数百メガワット単位で測られ、公共問題となっている。高精度浮動小数点ハードウェアはAIモデル支援のため精度を落とした演算に取って代わられつつある。国家戦略ではAI対応クラウドとスーパーコンピュータを融合した戦略的資源として扱う傾向が強まり、深い地政学的含意を帯びている。

「したがって、科学技術計算はますます専門化され、政策主導のニッチ分野となりつつある。これは他の、はるかに大きな市場向けに最適化されたハードウェアとソフトウェアの基盤の上に成り立っている。科学計算の課題は、この急速に変化する世界に適応することだ」と彼らは記す。「我々はAIの波に乗りつつ、同時に未来を築かねばならない。」

著者らは2023年の論文で提唱した五つの原則を基に、2027年に向けた七つの新たな原則を構築した:

- 同等のプロセスとしてのモデリングとAI

- データ移動と電力が支配的

- ベンチマークと評価

- 共同設計が真に重要

- 大規模プロトタイピング

- 学際的なデータキュレーションと融合

- 新たな官民連携

以下に、各原則の概要とHPC・科学計算への影響を簡潔に示す:

1.同等のプロセスとしてのモデリングとAI

現在の技術的変革の波は、過去の波と幾分似通っている。ベクトル型スーパーコンピュータであれ、スケーラビリティのないメッセージパッシングプロトコルであれ、旧来の技術に固執することは、過去と同様に今日の脅威であり、克服すべき課題である。

しかし、HPCのリーダーたちは重要な違いもあると言う。例えば、過去には科学計算コミュニティが消費者向け技術を論理的な限界まで押し上げることは合理的に期待できた。だが、それはもはや現実的ではない。

|

|

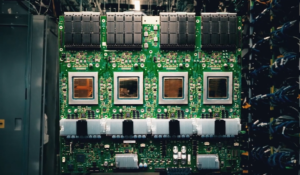

| Googleは新開発の「Ironwood」TPUチップでAI性能の限界に挑戦している | |

まず第一に、GoogleのTPU、Amazon Trainium、Microsoft Maiaといった世界最速クラスのプロセッサは、購入すらできない(レンタルは可能だが)。さらに、AI計算の規模は今や桁違いだ。「今日の『AI工場』の規模は、TOP500スーパーコンピュータリストの最高速マシンさえも凌駕しており、その差は年々拡大している」と彼らは記す。

ドンガラ、ガノン、リードはまた、焦点がAIワークロードに移るにつれてプロセッサの能力も変化したと指摘する。従来のモデリング・シミュレーションワークロードでは依然として高精度FP64性能が大量に求められるが、機械学習アルゴリズムを駆動するチップの開発にははるかに大きな利益が見込める。機械学習では性能の最適点が低精度(4ビットから32ビット)性能にあるからだ。

科学計算コミュニティは精度変化に適応する必要があると彼らは記す。「将来の数値ソルバーは、64ビット(FP64)浮動小数点演算を均一に想定するのではなく、FP64、FP32、BF16、FP8、整数エミュレーション形式に計算を分割し、安定性や精度が最も必要な箇所にのみ高精度を用いるだろう」と彼らは記す。

計算科学の演繹的性質と物理法則に基づく優位性、対してAI推論の帰納的性質と数値モデルに基づく劣位性を高慢に論じる代わりに、HPCのリーダーたちは異なるアプローチを提唱する。

「計算モデルが微分方程式の解を任意の精度で近似できるのと同様に、AIモデルも未知の関数を任意の精度で近似することを学習できる」と彼らは記している。「重要なのは、モデリング・シミュレーションかAIかのどちらかに投資する選択の問題ではない。両者は不可欠で補完的であり、それぞれが他方に欠ける能力と効率性を提供しているのだ。」

2.データ移動と電力が支配的

現代のAIワークロードは、膨大な量のメモリ移動に依存している。これは電力と冷却のための莫大な電力を意味する。したがって、先見の明のある計算科学者は、それほど多くのデータを移動する必要のないシステムを構築すべきだ。

|

|

| かつては稀だった液体冷却が、HPCでは必須となった(Matveev Aleksandr/Shutterstock) | |

「メッセージとデータ移動を最小化する従来の研究は、現代の通信ファブリック、オフロードエンジン、階層的メモリシステムという文脈で再解釈されねばならない」とHPCリーダーたちは記す。

「ランタイムはエネルギーコストと通信コストの両方を認識し、ラックや施設間での高コストなデータ移動を最小化するようタスクをスケジューリングし、可能な限り近接メモリやネットワーク内計算を活用する必要がある。ハイブリッドAI+シミュレーションワークフローは、非同期でイベント駆動型の通信パターンに依存する。これによりシステムの異なる部分が、絶え間ないグローバル同期なしに、それぞれの自然な時間スケールで動作できるのだ。」

ドンガラ、ガノン、リードは、あらゆる形態の計算進歩を大規模に遅らせる恐れのある他の逆風にも取り組んでいる。AI工場が大きくなるにつれ、電力網への要求も同様に増大する。ハイパースケールデータセンターは数ヶ月で立ち上げられるが、その稼働と冷却に必要なギガワット時の電力を供給するには数年を要するのだ。

3.ベンチマークと評価

電力事情もまた、従来の性能指標を時代遅れにしている。ピーク浮動小数点演算性能(FLOPS)に代わるより優れた指標は「ソリューションあたり消費ジュール数」だと彼らは記している。

「この指標は、精度、解像度、モデルサイズ、エネルギー消費量の間で新たなトレードオフを迫る」と彼らは記す。「またアルゴリズム革新の役割を浮き彫りにする。混合精度手法、通信回避アルゴリズム、データ圧縮、より賢いサンプリングとサロゲートモデルは、信頼性を損なうことなく、解ごとのジュール数を削減できる。時には劇的に削減できる。」

4.共同設計が真に重要

AIの波を乗り切るため、HPCのリーダーたちは計算科学者がハイパースケーラーが長年行ってきたのと同じ種類のエンジニアリング共同設計手法を採用するよう勧めている。

「科学計算は単に新アーキテクチャを待ち、後から適応するだけでは不十分だ」と彼らは記す。「代わりに、ハードウェア機能(数値精度フォーマット、オンダイネットワーク、メモリ階層、DPU)を科学アルゴリズムとの対話で形作り、ソフトウェアスタックがそれらの機能を実用的かつ移植性の高い形で提供する、目的指向の協業が必要である。」

5.大規模プロトタイピング

2023年当時ですら、大規模なプロトタイピングを推進する必要性は明らかだった。しかしAIの登場により、その必要性はさらに加速したとHPCのリーダーたちは言う。カスタムチップレットの開発など、リスクを厭わないスタートアップや研究所を通じた取り組みには、数千万単位の巨額投資が必要だと彼らは記している。

|

|

| チップレット(例えばこれらのAMD EPYC CPU)は、HPCをスケーリングするための低エネルギー・高データ密度経路を提供する | |

「スケーラブルなテストベッドがあって初めて、新しいハードウェア、ソフトウェアスタック、エネルギー管理戦略を、現実的な条件下で幅広い科学ワークロードによって実行できる」と彼らは記す。「これは単純でも容易でもないが、商用市場向けに設計されたハードウェアの限界に対処するためには不可欠だ。」

特定のソフトウェアスタックを搭載した汎用マシンを作るよりも、このアプローチは核融合や健康分析といった特定の問題群に対して、その課題解決に特化したソリューションを生み出す可能性がある。

6.学際的なデータキュレーションと融合

データとモデルは「知的財産」だと著者らは記す。長期気候再解析データ、核融合診断データ、高解像度地球観測アーカイブ、精選された材料データ、分子データベースといったデータセットは、生成と維持に多大なコストがかかる。

データ自体に価値はあるが、最先端の生成系AIモデルと組み合わせてハイブリッドAIシミュレーションに活用することで、その価値は飛躍的に高まる。この手法は「他の方法では不可能なほど、より多くの知見を、より迅速かつ確実に得られる」と彼らは記している。

これによりデータ管理の重要性がさらに高まる。著者らは「データ管理は国家および機関戦略の中核要素でなければならない」と記している。「高品質なメタデータ、出所追跡、キュレーション、長期保存への投資は、将来の科学的成果を生み出すための投資である。」

7.新たな官民連携

人工知能と従来のモデリングを組み合わせることで、能力が飛躍的に向上した。これにより中央政府の注目が集まり、新たな科学計算の受益者かつ支援者となった。

|

|

ドンガラ、ガノン、リードは「ジェネシス型イニシアチブ」を支持している。これは政府がAI for Scienceへの投資拡大の必要性を位置付ける手段であり、特に気候変動への耐性、健康、エネルギー転換、国家安全保障、経済競争力といった戦略的課題への対応に有効だ。

著者らは「公的資金による科学計算は、既存の計算機ハードウェアを受動的に購入するだけでは成功しない」と指摘する。「AIとHPCを長期的な国家戦略資産と位置付け、ハードウェア・ソフトウェア・データ・人材を一貫したミッションで統合する、積極的な連合型資金モデルが必要だ」と述べている。

次世代計算基盤設計に向けた国家的挑戦

新たな道筋がなければ、科学計算コミュニティはAI特化型ハイパースケーラーの進歩に完全に依存するようになる、とHPCのリーダーたちは主張する。「実用的な」エネルギーや炭素の制約がないため、AI工場はただ巨大化し続けるだけだ。

ドンガラ、ガノン、リードはAIの恩恵を完全に断つことを提案しているわけではないが、「科学には、ピーク性能ではなく、信頼できる解を得るためのジュール消費量を桁違いに削減することを主目的とする、対抗的な国家プログラムが必要だ」と主張している。

彼らが「次世代計算基盤のムーンショット」と呼ぶこのシステムは、「エネルギー比例型コンピューティング」「極端なデータ移動の節約」「数値精度・通信・検証を後付けではなく第一級のリソースとして扱うアルゴリズムとアーキテクチャの共同設計」といった「根本的に異なる設計ポイント」に焦点を当てる。

このようなムーンショットの試みはリスクを伴うと彼らは記す。実際、失敗を受け入れる覚悟が必要であり、ベンダーが最適化を図る方法や政府が調達サイクルで漸進的アップグレードを好むといった既存のインセンティブ構造への挑戦を伴う。

「多くの点で、コンピューティングが個人利用に十分な小型化・低コスト化を果たした時、最も変革的になった。国家レベルでの対応策は、高度な能力をコンパクトかつ再現可能で普遍的にし、科学がワークフローをエンドツーエンドで所有できるようにすることだ」とドンガラ、ガノン、リードは記す。

「このプロジェクトの成果はジェネシスを置き換えるものではない」と彼らは結論づける。「補完するものであり、公共科学が他者のビジネスモデル向けに設計された計算・記憶資源を借り続けるという永遠の制約から解放されることを保証する。」

論文はこちらからダウンロードできる。